Apple entwickelt seit einiger Zeit ein autonomes Leitsystem für Autos, ursprünglich war es für ein Auto des amerikanischen Unternehmens gedacht. Angesichts der Tatsache, dass dieses Projekt von der Apple-Firma abgesagt wurde, setzen die Unternehmen aus Cupertino ein Projekt fort, das auf der Entwicklung eines autonomen Leitsystems für Autos basiert.

Dieses System würde Apple an Autohersteller verkaufen, und heute erfahren wir einige interessante Informationen darüber. Apple setzt bei der Entwicklung dieses Systems auf die LIDAR-Technologie, die in der Lage ist, Fußgänger, Autos und Radfahrer aus großer Entfernung zu erkennen. Dabei kommen eine Reihe von Kameras und spezielle Software zum Einsatz hier beschrieben.

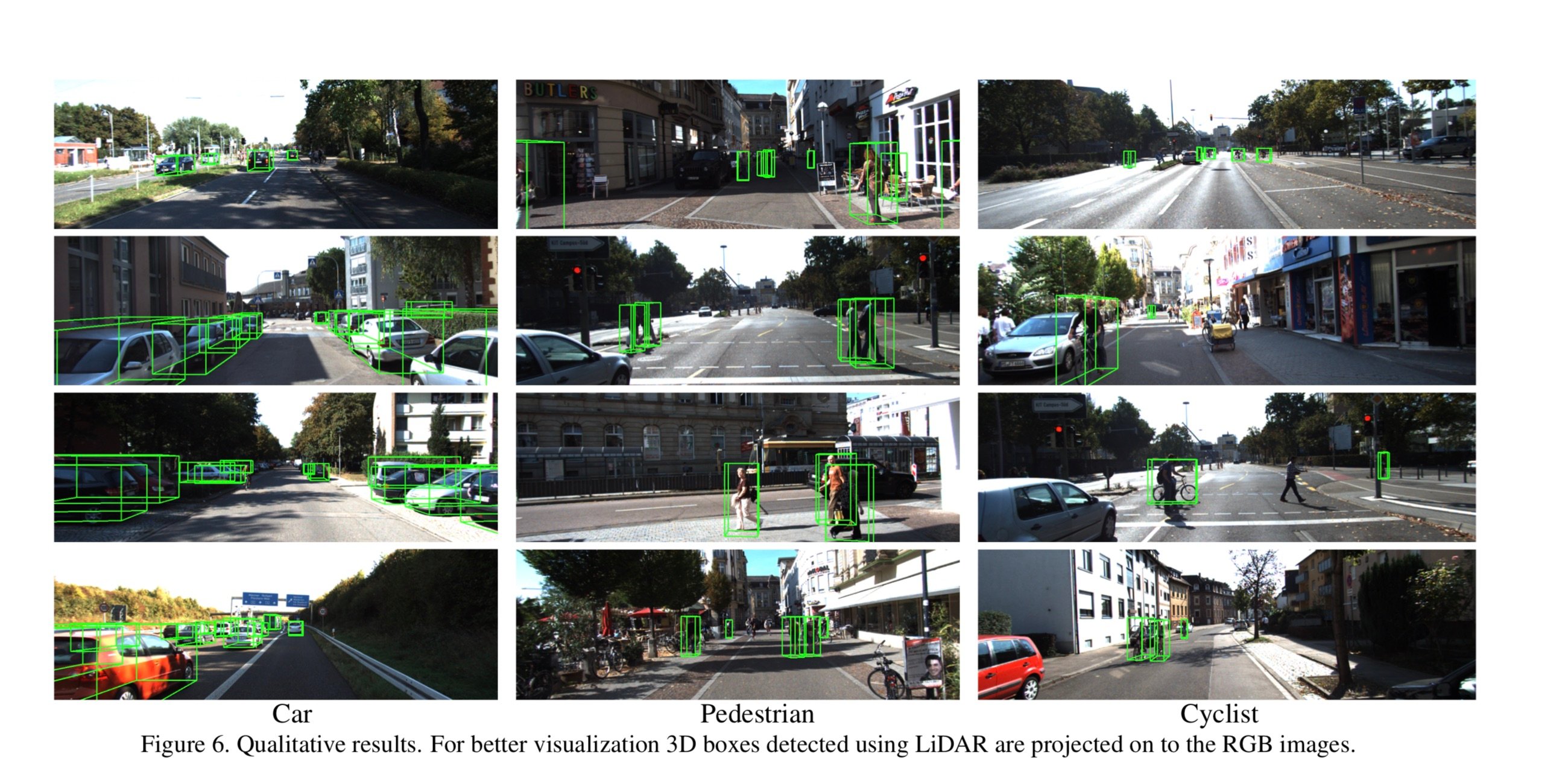

„Die genaue Erkennung von Objekten in 3D-Punktwolken ist ein zentrales Problem in vielen Anwendungen, wie etwa autonomer Navigation, Reinigungsrobotern und Augmented/Virtual Reality.“ Um eine sehr spärliche LiDAR-Punktwolke mit einem Region Proposal Network (RPN) zu verbinden, konzentrierten sich die meisten bestehenden Bemühungen auf handgefertigte Feature-Darstellungen, beispielsweise eine Projektion aus der Vogelperspektive. In dieser Arbeit machen wir das manuelle Feature-Engineering für 3D-Punktwolken überflüssig und schlagen VoxelNet vor, ein generisches 3D-Erkennungsnetzwerk, das Feature-Extraktion und Bounding-Box-Vorhersage in einem einstufigen, durchgängig trainierbaren tiefen Netzwerk vereint.“

Apple behauptet, dass die von ihm entwickelte Technologie Menschen und Radfahrer besser erkennen kann als andere ähnliche Technologien, die auf die Erkennung von 3D-Objekten abzielen. Derzeit hat Apple nur Softwareexperimente durchgeführt, ohne zu echten Tests überzugehen, sodass die Technologie noch nicht vollständig für die Implementierung in einem Automobil geeignet ist.

Bis dies geschehen kann, erlaubt Apple seinen Ingenieuren, Arbeiten zu veröffentlichen, die sich auf die von ihnen entwickelte Technologie beziehen. Der Zweck dieses Prozesses besteht darin, die Informationen so vielen Menschen wie möglich zugänglich zu machen, damit sie Hilfe bei der Entwicklung der Software und Hardware erhalten. Es bleibt jedoch abzuwarten, wie erfolgreich sie sein werden.

„Die meisten vorhandenen Methoden der LiDAR-basierten 3D-Erkennung basieren auf handgefertigten Merkmalsdarstellungen, beispielsweise einer Projektion aus der Vogelperspektive.“ In diesem Artikel beseitigen wir den Engpass des manuellen Feature-Engineerings und schlagen Vox-elNet vor, eine neuartige, durchgängig trainierbare Tiefenarchitektur für die punktwolkenbasierte 3D-Erkennung. Unser Ansatz kann direkt auf spärliche 3D-Punkte einwirken und 3D-Forminformationen effektiv erfassen. Wir präsentieren außerdem eine effiziente Implementierung von VoxelNet, die von der Punktwolkensparsität und der parallelen Verarbeitung auf einem Voxelgitter profitiert.“

Das Unternehmen Apple ist fest entschlossen, dieses autonome Leitsystem auf den Markt zu bringen. Es wird von vielen Menschen erwartet und es wird äußerst interessant sein zu sehen, ob es erfolgreich sein wird oder nicht.

„Unsere Experimente zur KITTI-Autoerkennungsaufgabe zeigen, dass VoxelNet modernste LiDAR-basierte 3D-Erkennungsmethoden bei weitem übertrifft.“ Bei anspruchsvolleren Aufgaben wie der 3D-Erkennung von Fußgängern und Radfahrern zeigt VoxelNet ebenfalls ermutigende Ergebnisse, die zeigen, dass es eine bessere 3D-Darstellung bietet.“