Apple es una empresa que innova constantemente y hoy la oficina de patentes y marcas de EE.UU. publicado una patente de Apple que describe una cámara 3D capaz de reconocer objetos, gestos y expresiones faciales de los usuarios. La cámara utiliza microlentes, un software que detecta la "profundidad" de los objetos y sensores luminiscentes para generar modelos 3D de objetos, reconocer gestos realizados por los usuarios y reconocer sus expresiones faciales. Las cámaras 3D podrán usarse con aplicaciones especialmente creadas por Apple o incluso para desbloquear un iDevice usando la cámara frontal.

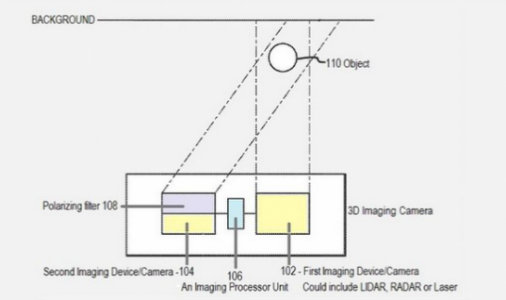

Apple ha inventado una espectacular cámara de imágenes 3D que se aplicará tanto a la fotografía como al vídeo. Las nuevas cámaras en desarrollo utilizarán nuevos sensores de detección de profundidad como LIDAR, RADAR y Laser que crearán mapas de disparidad estéreo al crear imágenes en 3D. Además, las cámaras utilizarán sensores avanzados de crominancia y luminancia para una precisión de color superior. Y por si fuera poco, las nuevas cámaras no sólo incluirán reconocimiento facial sino también reconocimiento de gestos faciales.

La tecnología de Apple utilizaría una o más cámaras para interpretar los objetos colocados frente a ellos y si habláramos de expresiones faciales, entonces el software incluido en iOS sería capaz de reconocer: muecas, sonrisas, gestos de ceño fruncido, el "guiño" gesto y muchos, muchos otros. El software diseñado por Apple seguiría atentamente los músculos de la cara, nariz, boca, ojos, frente, etc. y calcularía geométricamente los cambios que se producen cuando el usuario realiza un determinado gesto.

Los gestos faciales pueden incluir, entre otros, sonreír, hacer muecas, fruncir el ceño, guiñar un ojo, etc., etc. En una realización, esto se puede lograr detectando la orientación de varios músculos faciales usando datos de geometría de superficie, tales como la boca, los ojos, la nariz, la frente, las mejillas, etc., y correlacionando las orientaciones detectadas con diversos gestos.

Las ideas de Apple son muy interesantes y podrían utilizarse en muchas aplicaciones, pero por ahora sólo se describen y están lejos de implementarse en ningún iDevice.